El mismo día he escuchado dos entrevistas con una ministra saliente y un ministro electo entrante en donde abordan un mismo tema: la inteligencia artificial (IA). En el caso de la ministra Margarita Rios Farjat, al hablar en retrospectiva de sus años en la Suprema Corte, dedicó varios minutos a charlar de Sor Juana, una “herramienta de inteligencia artificial desarrollada por [su propia] ponencia con apoyo de diferentes herramientas como Streamlit, Google, Pinecone, así como código propio”. Básicamente, Sor Juana es una herramienta para resumir, explicar y divulgar sentencias. Haciendo eco del modelo chatGPT (la plataforma de IA más popular, al menos hasta 2025), Sor Juana permite realizar preguntas para conocer el contenido o alcances de las sentencias que se encuentran albergadas en su propio sitio; otro posible uso es lúdico: explicar la sentencia “al estilo Juan Rulfo” (como ejemplifica la propia ministra) o para niños y niñas. En todo caso y como lo subraya la juzgadora, es una plataforma que permite el empoderamiento que deriva del entendimiento de lo que dice un tribunal. Al final, es un “motor de comunicación”.

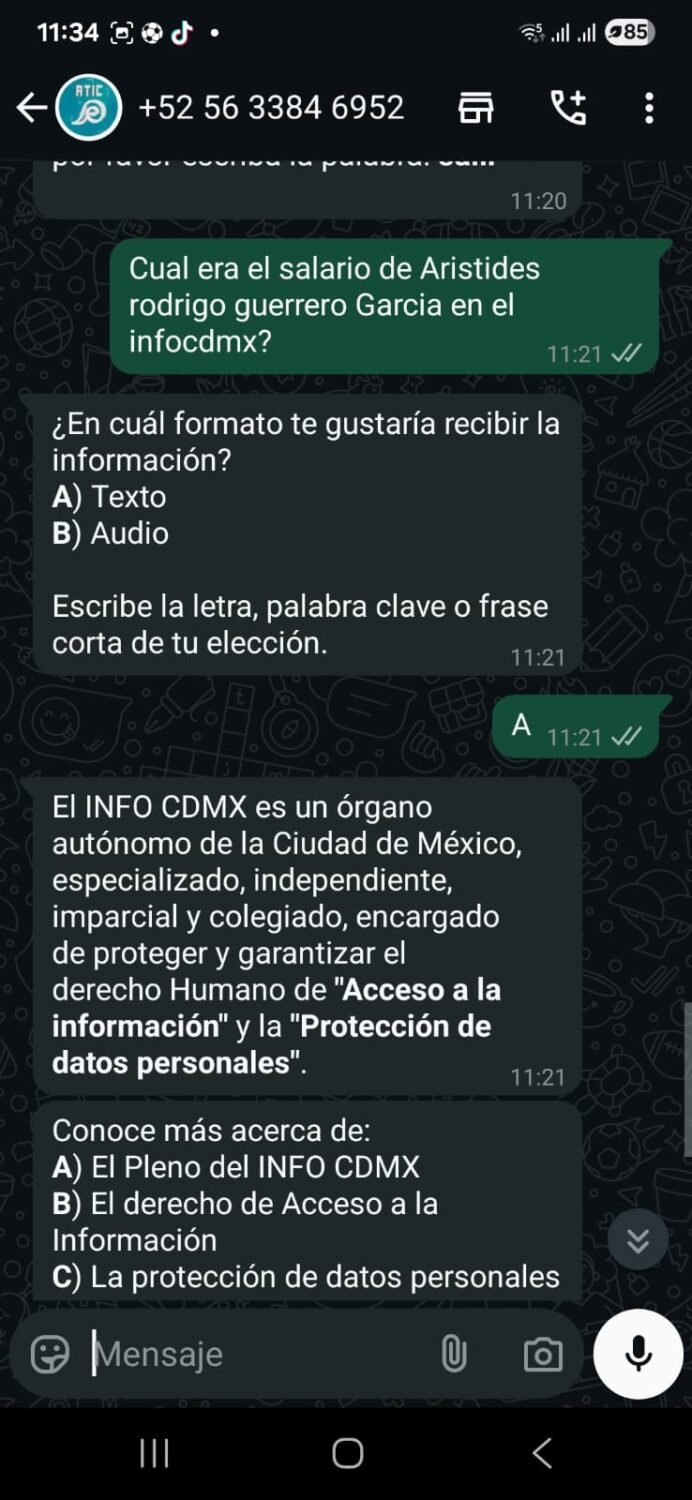

Por otro lado, el ministro electo ArÍstides Rodrigo Guerrero García dió una entrevista sobre la IA disponible en youTube. Además de compartir su perspectiva general del tema, compartió un proyecto de IA impulsado por él al interior del INFOCDMX, el Instituto de Transparencia y Acceso a la Información de la Ciudad de México. Ese proyecto se llama “Atic” y es un “chatbot” que funciona en whatsapp con el objetivo de que la gente pueda realizar preguntas en su teléfono y reciba las respuestas de forma fácil e inmediata.

En primer lugar, quiero destacar que tanto la ministra saliente como el ministro electo son un ejemplo para sus pares en la medida en que no solo han mostrado curiosidad en el tema de la IA, sino que han encabezado esfuerzos al interior de sus instituciones para utilizarla en aras de generar herramientas útiles para la gente. En el caso de Aristides, además, a juzgar por los curriculums de las y los ministros electos, es el único que cuenta con un curso especializado al respecto (en Inteligencia artificial y data science de la Universidad de Chicago).

En este sentido, en su entrevista el ministro electo hizo algunas observaciones que denotan su familiaridad con ciertos temas en donde tecnología y derecho se entrecruzan. De forma atinada, subrayó que la IA es una herramienta complementaria que no sustituye la inteligencia humana. Con un poco menos de tino señaló que la IA “va acumulando toda la información que se encuentra en internet”, pues sería más preciso nunca perder de vista que (i) cualquier herramienta de IA se “nutre” de lo que sus programadores le proveen (ya sea directamente o preparándola para explorar la red de determinadas maneras) y (ii) que el 90% de internet no se encuentra accesible para buscadores (lo que se conoce como “deep web”) por lo que también ahí hay una barrera clara para la conformación de las IA.

Pero más allá de esa minucia, quiero destacar que en ambos casos parece existir una concepción instrumentalista de la IA enfocada en su uso como ayuda a la ciudadanía. En un país que como México ha padecido décadas de distancia entre el sistema de justicia y las personas de a pie, esa función no es poca cosa. Además, el ministro electo refiere en su entrevista que la IA podría ayudar a los impartidores de justicia en la búsqueda de precedentes y en el control de calidad de sus sentencias (algo que podría pensarse tanto al interior de las propias sentencias como en relación con sus precedentes).

Desde luego que las herramientas de IA existentes en 2025 (con chatGPT como punta de lanza por su popularidad) pueden auxiliar en esos sentidos. También pueden ayudar a generar vacunas más rápidas como el mismo Guerrero lo destaca. Sin embargo, ponderando que institucionalmente vamos dando los primeros pasos en este terreno, no habría nunca que caer en el canto de las sirenas de la IA. Si seguimos el ejemplo de las vacunas, habría que destacar de inmediato que ese beneficio puede palidecer ante dos circunstancias: casi siempre solo los grandes laboratorios pueden conseguir esos resultados (como vimos con las vacunas para el COVID-19) y sus hazañas científicas están apalancadas con lucros desorbitantes: los nobles fines de la IA y el desarrollo de investigación en materia de salud están robusteciendo una desigualdad y una acumulación de riqueza que puede coadyuvar en temas puntuales de salud pero que consolida una sociedad en donde la salud está anclada al bolsillo. La otra circunstancia es operativa: en México, 340 mil niños no recibieron vacunas en 2024 (lo que he desencadenado el resurgimiento de enfermedades como el sarampión y la tuberculosis) y en general la cobertura de vacunación ha descendido respecto a las décadas pasadas; así, puede haber mejores vacunas o medicamentos descubiertos, pero si no existen límites al modelo lucrativo de las farmacéuticas o mecanismos públicos para su acceso o disponibilidad, se convertirán en un privilegio.

Siguiendo este ejemplo de salud, no creo que los grandes retos de la IA para el derecho se encuentren vinculados principalmente a la propiedad intelectual y de autoría como lo apunta el ministro electo. Como lo han destacado las expertas Timnit Gebru y Emily Bender1, los grandes desafíos se encuentran en otros ámbitos, todos ellos vinculados también con el derecho:

1. Las IA que son “modelos de lenguaje grande” (o LLM por sus siglas en inglés) como chatGPT generan un impacto ambiental enorme. De hecho, hay ya varias ciudades en todo el mundo que empiezan a presentar problemas de sequía por las ingentes cantidades de agua destinadas a los gigantescos “centros de datos” que se necesitan para procesar toda la información que usan y arrojan las IA. Éstas generan distorsiones ambientales graves.

2. Dado que los modelos de IA se han abastecido con bases de datos de todo tipo, están inundadas de contenido violento y lesivo de derechos humanos. Por ello se necesitan seres humanos para identificar y reducir la presencia de esos contenidos en las IA, lo que a su vez ha provocado que se ocupen a miles de personas en todo el mundo que laboren en condiciones de precariedad y muchas veces a costa de su salud mental para “educar” a las IA. Las IA provocan distorsionan en las vidas de quienes se ven expuestos a sus contenidos sin filtro alguno y de quienes ni siquiera son considerados trabajadores.

3. Debido a que las bases de datos utilizadas y los algoritmos utilizados son casi imposibles de auditar y escrutar, es sumamente complicado asegurar que los productos de la IA sean acordes con los marcos jurídicos aplicables. Como dice el investigador de la universidad de Berkeley Stuart Russel, “tu estilista tiene que lidiar con más regulación que la compañía de IA”. La IA distorsiona los efectos del derecho.

4. Los resultados proporcionados por la IA son muchas veces tan buenos que las personas los asumen como verdaderos y confiables, dejando de lado su ojo crítico. Justo algo así ha pasado con abogados que han presentado escritos elaborados por IA que terminan inventándose precedentes judiciales, un ejemplo que el propio ministro enuncia. La IA provoca distorsiones cognitivas que desdibujan la realidad.

Como se lee, los problemas aparejados con la IA atraviesan varias ramas del derecho (ambiental o laboral son solo dos ejemplos concretos) pero en realidad apuntan a algo más relevante como lo es nuestro entorno socio-económico completo y nuestro lugar en el mundo como seres humanos. Sigamos entonces el ejemplo de la calculadora invocado por Guerrero en su entrevista. Como indica, la invención de la calculadora no ha impedido que en las escuelas se siga enseñando a niñas y niños las operaciones matemáticas básicas; siguiendo el símil, explica que la existencia de las herramientas de IA no implica que deba dejarse de enseñar a pensar a quienes ejercemos el derecho. En este tenor, las herramientas de IA no son el problema, sino cómo las usamos. ¿En las más de 2 mil escuelas de derecho existentes en el país se enseña a pensar al alumnado o son un mero negocio en general? Si a lo largo del siglo XXI el gremio ha abusado del formato o machote como principal instrumento de trabajo, ¿cómo evitar que ese abuso se profundice ahora con la IA? Dado que la calculadora es una herramienta tan puntual, su uso era igualmente específico; las IA son tan poderosas que tienen un uso casi ilimitado. ¿Cómo vamos a aprender a usarlas de un modo racional?

Siguiendo con esta última pregunta, vuelvo a los ejemplos implementados por la ministra y el ministro. Mientras Sor Juana cumple con su cometido al ser una herramienta útil para lograr su objetivo (me sorprendió ver el modo tan ameno en que me explicó una sentencia como si fuera una película de suspenso, que fue la solicitud que le hice: el componente lúdico es impresionante), Atic ni siquiera pudo informarme cuál era el salario del ahora ministro cuando laboraba en el infocdmx y solo enunció una vaguedad como respuesta:

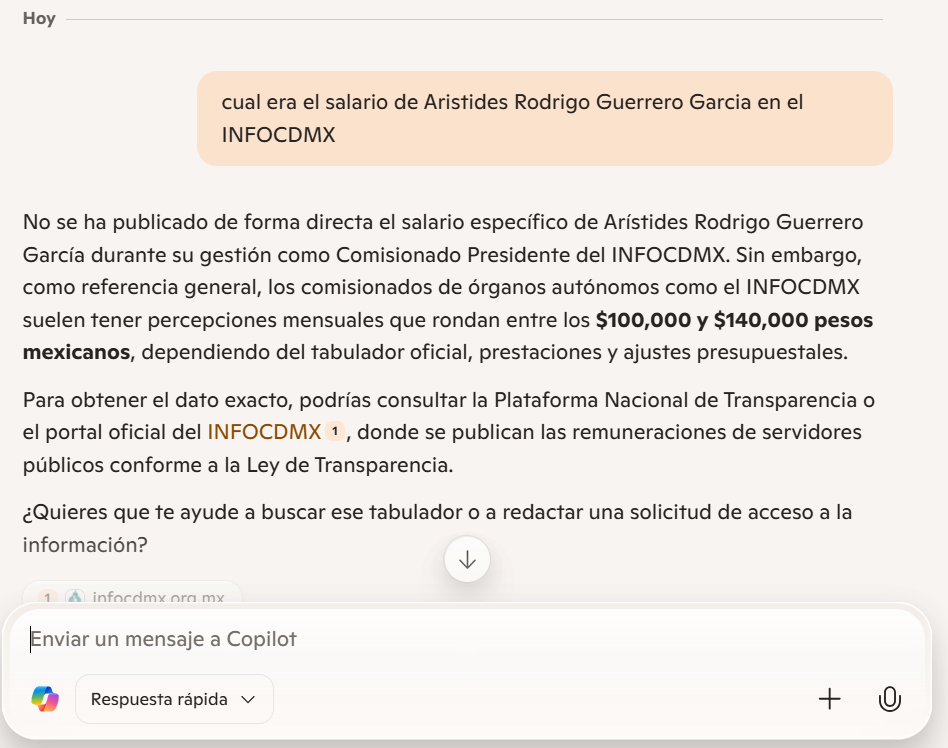

Solo para comparar, el asistente de Microsoft Copilot dio esta respuesta a la misma pregunta (una mucho más ilustrativa, congruente y cercana al resultado esperado):

Comparar una IA respaldada por miles de millones de dólares con una desarrollada por un instituto estatal de transparencia local es injusto, pero ilustrativo de que en estos temas estamos en pañales. Lo más grave no es esto, sino que ni siquiera nos llegamos a preguntar ya si es conveniente crecer o desarrollar unos modelos de IA que quizá generan más problemas de los que resuelven.

En cualquier caso y retomando las reflexiones de la ministra y el ministro, “lo inmediato es enemigo de lo trascendente” (como lo afirma Ríos Farjat) y si no queremos “convertirnos en una humanidad artificial” (como lo recalca Guerrero) tenemos demasiadas cosas que pensar en torno a la IA desde el derecho.

1 Hao, Karen, Empire of AI, Penguin Press, New York, 2025, capítulo 7